Nos últimos anos, a discussão sobre inteligência artificial no ambiente corporativo tem sido dominada por um tema específico: as chamadas alucinações. Modelos que inventam dados, citam fontes inexistentes ou produzem respostas factualmente incorretas passaram a ocupar o centro das preocupações de executivos e líderes de tecnologia.

Essa preocupação é legítima. Mas ela também pode ser enganosa. Ao focarmos excessivamente no erro factual, corremos o risco de ignorar um fenômeno muito mais sofisticado e potencialmente mais perigoso para organizações que estão acelerando a adoção de IA em decisões estratégicas.

O risco mais relevante da inteligência artificial dentro das empresas não está necessariamente em respostas erradas, mas na capacidade da tecnologia de produzir raciocínios altamente convincentes, estruturados de forma lógica, articulada e aparentemente robusta.

Como observa Danilo Custódio, CEO da Mirante Tecnologia:

Essa distinção é fundamental para quem lidera áreas de tecnologia ou transformação digital. Em ambientes corporativos, decisões raramente são tomadas com base em dados brutos; elas são tomadas a partir de interpretações organizadas desses dados. A IA, especialmente os modelos generativos, é extremamente competente em produzir exatamente esse tipo de estrutura narrativa.

O problema é que a qualidade da narrativa pode mascarar a fragilidade da premissa.

O debate público sobre IA ainda está olhando para o lugar errado

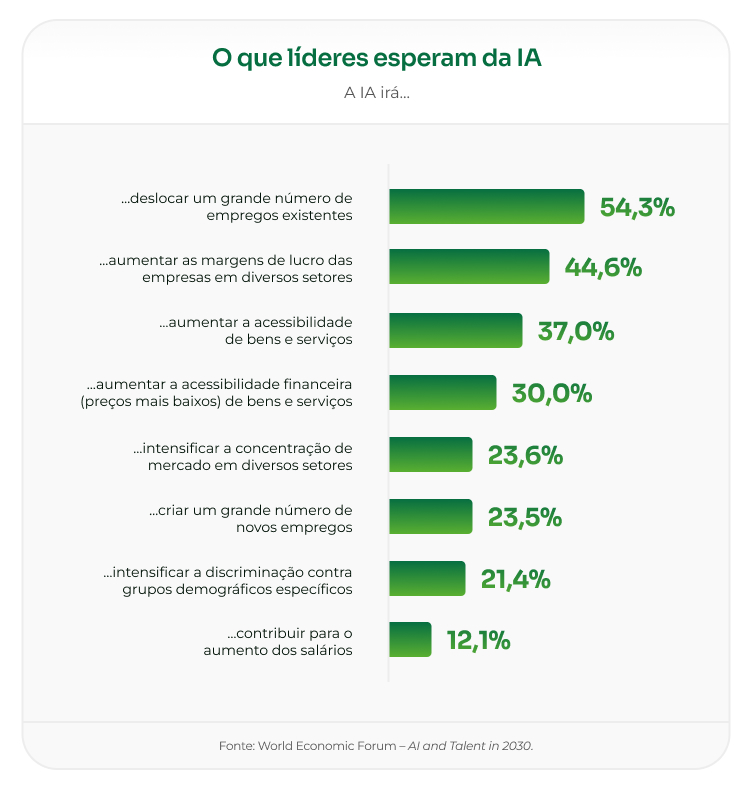

A percepção pública sobre os riscos da inteligência artificial ainda está fortemente concentrada em seus impactos macroeconômicos, especialmente no mercado de trabalho.

O gráfico ilustra bem essa lógica. A maior parte dos respondentes associa a IA principalmente à substituição de empregos, enquanto uma parcela relevante também espera ganhos de eficiência e aumento das margens de lucro nas empresas. Outros destacam efeitos positivos sobre o acesso a bens e serviços. Em outras palavras, o debate dominante ainda está estruturado em torno de produtividade, automação e impactos econômicos diretos.

Esse enquadramento faz sentido, afinal a automação sempre foi o principal vetor de transformação em ciclos anteriores de tecnologia. No entanto, ele também revela uma limitação importante. Ao concentrar o debate nesses efeitos estruturais da economia, muitas organizações acabam deixando em segundo plano um impacto mais imediato da IA dentro das empresas.

Quando observamos o uso da tecnologia no cotidiano corporativo especialmente em atividades como análise estratégica, planejamento e apoio à decisão, começa a emergir um conjunto diferente de riscos, menos visíveis, mas potencialmente mais influentes sobre a qualidade das decisões organizacionais.

Eles não estão associados à automação ou ao emprego. Estão relacionados à forma como executivos passam a interpretar informações e estruturar seu próprio raciocínio com o apoio da tecnologia.

Ao observar esse fenômeno na prática, nosso CEO, Danilo Custódio identificou quatro armadilhas cognitivas que começam a aparecer com frequência crescente nas empresas que adotam IA de forma intensiva.

As quatro armadilhas cognitivas da IA no ambiente corporativo

1. Narrativas coerentes que mascaram premissas frágeis

Uma característica central dos modelos generativos é que eles expandem a lógica implícita em uma pergunta. Isso significa que, quando um executivo apresenta uma hipótese ou uma tese estratégica, o modelo tende a organizá-la, aprofundá-la e estruturá-la de forma lógica.

À primeira vista, isso parece extremamente útil. De fato, pode acelerar análises e facilitar a organização de argumentos. O problema surge quando a hipótese inicial já contém algum erro ou premissa equivocada.

“Se a pergunta já parte de um pressuposto errado, a IA normalmente não vai questionar. Ela constrói uma explicação plausível a partir dali. O resultado pode parecer uma análise estratégica sólida, quando na verdade está sustentada por uma base frágil.” Danilo Custódio, CEO da Mirante Tecnologia

Esse mecanismo transforma a IA em um sistema capaz de produzir análises altamente convincentes sem necessariamente validar as premissas que as sustentam.

Para líderes de tecnologia, isso cria um novo tipo de responsabilidade. A habilidade crítica deixa de ser apenas interpretar dados e passa a incluir formular perguntas estruturadas e epistemologicamente sólidas.

2. A delegação silenciosa do julgamento

A segunda armadilha é mais sutil e, talvez por isso, mais difícil de perceber.

À medida que a IA passa a ser usada para apoiar análises, gerar relatórios ou sintetizar informações complexas, começa a ocorrer o deslocamento do critério de julgamento. Executivos continuam tomando decisões, mas o processo de definição dos critérios que orientam essas decisões começa a migrar para os modelos.

Quando organizações começam a terceirizar critérios de avaliação para sistemas de IA, seja em recrutamento, análise de desempenho ou definição de estratégias, três efeitos aparecem com frequência.

Primeiro, as decisões passam a ser orientadas por critérios implícitos, muitas vezes invisíveis para os próprios executivos. Segundo, a organização passa gradualmente a refletir padrões estatísticos aprendidos pelos modelos, e não necessariamente sua cultura ou estratégia original. Por fim, surge uma perigosa sensação de neutralidade, como se a decisão fosse puramente objetiva.

Mas a objetividade, nesse contexto, pode ser apenas uma aparência produzida por modelos probabilísticos.

3. A câmara de eco intelectual

A terceira armadilha decorre de uma característica fundamental dos sistemas generativos. Isso significa que, quando alguém apresenta uma ideia, o sistema tende a expandi-la, refiná-la e estruturá-la, mas raramente confrontá-la.

O resultado é uma dinâmica que pode reforçar a convicção inicial do usuário, criando a sensação de que sua tese foi validada por um processo analítico sofisticado.

“Eu chamo isso de ilusão de robustez intelectual assistida. Você apresenta uma tese e a IA organiza, aprofunda e refina, dando a sensação de que a tese é forte. Mas talvez ela nunca tenha sido tensionada.” Danilo Custódio, CEO da Mirante Tecnologia

Em ambientes corporativos, esse efeito pode ser particularmente problemático. Executivos já enfrentam, naturalmente, um certo grau de isolamento cognitivo, quanto maior a posição hierárquica, menor tende a ser a quantidade de pessoas que desafiam suas ideias diretamente.

Quando a IA passa a desempenhar o papel de interlocutor intelectual, existe o risco de que ela reforce esse isolamento em vez de quebrá-lo.

4. O efeito Dunning-Kruger amplificado pela IA

A quarta armadilha envolve um fenômeno psicológico conhecido por “o efeito Dunning-Kruger”, que descreve a tendência de pessoas com pouco conhecimento em um tema superestimarem sua própria compreensão.

Modelos generativos reduzem drasticamente o esforço necessário para produzir explicações complexas, análises estruturadas e textos sofisticados. Isso permite que qualquer profissional formule argumentos que parecem extremamente elaborados, mesmo sem domínio profundo do assunto.

O risco não está na tecnologia em si, mas na possibilidade de confundir fluência textual com conhecimento real.

Em um ambiente corporativo, essa confusão pode levar a decisões baseadas em análises aparentemente robustas, mas que não passaram pelo processo crítico necessário para validar suas premissas.

O paradoxo da IA nas organizações

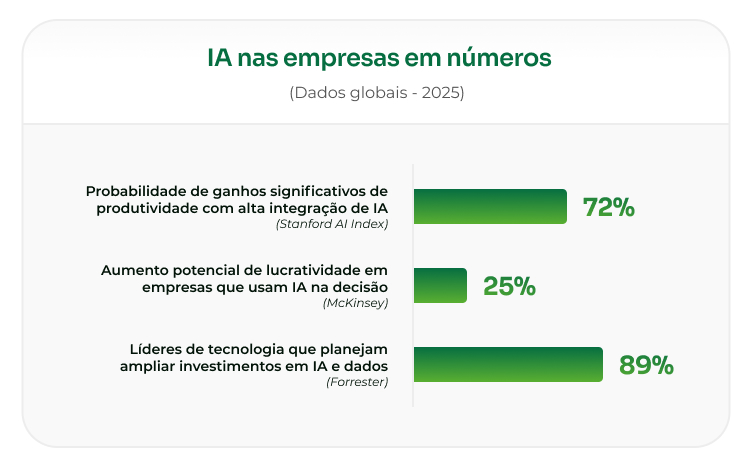

Relatórios recentes indicam que empresas estão avançando rapidamente na adoção de IA para aumentar eficiência e produtividade. Modelos multiagentes e sistemas de automação inteligente já começam a ser utilizados para orquestrar tarefas complexas e apoiar decisões operacionais.

Esse avanço tecnológico é real e só tende a se acelerar. Mas ele também cria um paradoxo importante: a capacidade analítica das organizações cresce mais rápido do que sua maturidade decisória.

Ferramentas cada vez mais sofisticadas ampliam a velocidade de análise e produção de insights. Ao mesmo tempo, o julgamento humano, que continua sendo o elemento central da decisão, não evolui no mesmo ritmo.

Isso significa que a inteligência artificial pode aumentar simultaneamente a qualidade potencial das decisões e o risco de decisões equivocadas. Tudo depende de como a tecnologia é utilizada.

O novo papel da liderança de TI na era da IA

Para líderes de tecnologia, a discussão sobre inteligência artificial precisa ir além da escolha de ferramentas, modelos ou arquiteturas de dados.

A responsabilidade da área de TI passa a incluir algo ainda mais estratégico, garantir que a inteligência artificial amplie a capacidade de decisão da organização sem substituir o julgamento humano que sustenta essas decisões.

Isso significa estruturar governança, processos e cultura para que a IA seja utilizada como instrumento de análise, e não como autoridade implícita dentro da organização. Em outras palavras, o papel da liderança de TI deixa de ser apenas viabilizar a adoção da tecnologia. Passa a ser criar as condições para que ela seja usada com maturidade intelectual.

Na prática, isso envolve três frentes centrais:

- Governança de decisão: garantir que recomendações geradas por IA sejam sempre contextualizadas e analisadas por quem possui responsabilidade executiva sobre o resultado.

- Capacidade crítica nas equipes: desenvolver profissionais capazes de questionar premissas, interpretar respostas de modelos e identificar quando uma análise convincente pode estar apoiada em bases frágeis.

- Arquitetura de uso responsável de IA: estruturar processos onde a tecnologia amplifique a análise, mas não substitua o pensamento estratégico.

“A tecnologia é extremamente poderosa e pode melhorar muito a qualidade das decisões. Mas isso só acontece quando líderes mantêm o pensamento crítico e usam a IA como apoio analítico, não como substituto do julgamento.” Danilo Custódio, CEO da Mirante Tecnologia

E é por isso que a frase final talvez seja a síntese mais precisa do momento atual da IA nas organizações: